O que é Inteligência Artificial (IA)? Como surgiu, tipos e tendências

Se você também se pergunta o que é Inteligência Artificial, afinal, que todo mundo está usando mas não sabe como funciona exatamente, esse texto é para você!

Afinal, o que é Inteligência Artificial?

Conceitualmente, Inteligência Artificial (IA) é um campo interdisciplinar que busca desenvolver sistemas capazes de realizar tarefas que normalmente requerem inteligência humana. Essas tarefas incluem aprendizado, raciocínio, resolução de problemas, percepção visual e reconhecimento de fala.

Em um mundo cada vez mais digitalizado, a IA se destaca como uma tecnologia transformadora, moldando a forma como vivemos, trabalhamos e nos relacionamos.

Leia também: Tendências de Inteligência Artificial para 2024

A História da Inteligência Artificial

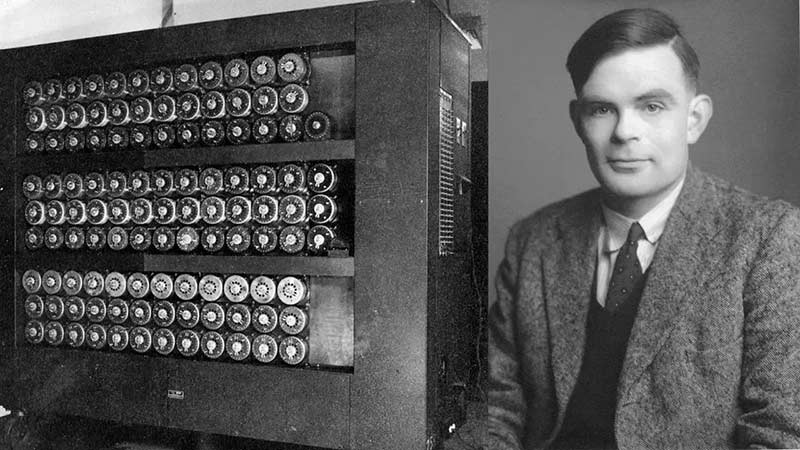

A origem da Inteligência Artificial (IA) remonta aos anos 50, quando visionários começaram a explorar a ideia de criar máquinas inteligentes capazes de pensar e aprender como humanos.

Entre esses pioneiros, destaca-se Alan Turing, um matemático britânico, cuja sua criação a “Máquina de Turing” estabeleceu os fundamentos teóricos da computação e teve um impacto duradouro no campo da IA.

A sua contribuição foi fundamental para a compreensão de como máquinas poderiam realizar tarefas lógicas e computacionais; o que foi um grande avanço, pois ela estabeleceu os fundamentos teóricos da tecnologia voltada para o desenvolvimento da Inteligência Artificial.

A Máquina de Turing e o Início da Revolução Computacional

A máquina consistia em uma fita infinita dividida em células, uma cabeça de leitura/escrita e um conjunto de instruções que dava à máquina a capacidade de mover-se pela fita, ler e escrever símbolos, e alterar seu estado de acordo com as instruções recebidas. Esse modelo permitiu que Turing demonstrasse que certos problemas matemáticos não eram passíveis de serem resolvidos por um algoritmo, inaugurando assim o campo da computação.

Para o leitor que quiser se aprofundar no mecanismo da máquina de Turing, há uma ferramenta que simula a mesma lógica de Turing e que te trará uma visualização melhor do conceito aqui explicado, é a Visual Turing 2.0.

As ideias de Alan Turing influenciaram diretamente o desenvolvimento das primeiras máquinas de computação e, por extensão, o campo da Inteligência Artificial.

Leia também: 6 sites de Inteligência Artificial para usar no trabalho!

Desdobramentos da Teoria de Turing e o Surgimento da IA Prática

Ao criar essa máquina, sua visão estabeleceu os alicerces para a compreensão teórica de como máquinas poderiam realizar tarefas intelectuais, um princípio essencial para o desenvolvimento posterior da IA.

Assim, a “Máquina de Turing” ultrapassa seu papel original na teoria da computação, tornando-se um símbolo icônico da inovação que impulsionou a evolução da Inteligência Artificial.

Contudo, o avanço prático em direção à IA só começou na década de 50, quando pesquisadores começaram a aplicar esses conceitos teóricos para criar programas e sistemas que pudessem ser semelhantes ao pensamento humano.

1. A Conferência de Dartmouth e o Início Oficial

O marco inicial para a IA foi a Conferência de Dartmouth em 1956, onde o termo “Inteligência Artificial” foi criado. Durante debates e discussões intensivas, os participantes delinearam os fundamentos e objetivos da Inteligência Artificial.

Realizada durante oito semanas em Hanover, New Hampshire, em 1956, a conferência reuniu 20 das mentes mais brilhantes da ciência da computação e da ciência cognitiva.

John McCarthy, um dos principais organizadores do evento, gerou o termo “Inteligência Artificial” para descrever o campo de estudo dedicado a criar máquinas capazes de realizar tarefas que, normalmente, requerem inteligência humana.

Os participantes visionários compartilharam a ideia de construir sistemas que pudessem:

- Compreender linguagem natural,

- Formar abstrações,

- Resolver problemas complexos

- Melhorar a si mesmos ao longo do tempo.

Essa conferência não apenas consolidou o termo “Inteligência Artificial”, mas também definiu as bases e os objetivos iniciais para o desenvolvimento da área.

O evento de Darthmouth (1956) é, portanto, amplamente reconhecido como um marco na origem da Inteligência Artificial, no seu processo de criação e início dos estudos.

Abaixo, abordaremos um pouco mais sobre os próximos passos na linha do tempo da origem da Inteligência Artificial.

2. Os Primeiros Passos (1950-1970)

Na década de 50 e durante os anos 60, a pesquisa em IA testemunhou os primeiros passos na tentativa de construir programas capazes de simular raciocínio humano. Entretanto, o otimismo inicial foi seguido por desafios práticos e teóricos.

O desenvolvimento de máquinas que pudessem aprender e pensar como seres humanos estava longe de ser uma tarefa simples.

3. O “Inverno da Inteligência Artificial” (1970)

Os anos 70 ficaram registrados na história da Inteligência Artificial como um período que testemunhou o que foi denominado o “inverno da Inteligência Artificial”.

Esse termo refere-se a uma fase caracterizada por uma desaceleração significativa no progresso da IA, impulsionada por cortes substanciais nos investimentos e desafios práticos que não foram completamente superados.

Após o otimismo gerado pela Conferência de Dartmouth em 1956, as expectativas iniciais para o desenvolvimento da Inteligência Artificial não foram plenamente atendidas na prática. O otimismo foi seguido por uma fase de reavaliação e, em muitos casos, de desilusão.

Os projetos ambiciosos enfrentaram desafios técnicos consideráveis, e a comunidade científica começou a perceber que a realização das metas propostas não seria tão rápida ou direta quanto inicialmente previsto. Os cortes nos investimentos desempenharam um papel crucial nesse período de desaceleração.

Desafios e Reflexões durante o “Inverno da Inteligência Artificial”

À medida que a realidade da complexidade técnica e dos recursos necessários para avançar na IA se tornava mais clara, os financiadores e patrocinadores começaram a questionar a viabilidade e o retorno imediato desses investimentos. Isso resultou em uma redução nos recursos disponíveis para as pesquisas, levando a uma diminuição de atividades e projetos nesse campo.

O “inverno da Inteligência Artificial” não significou o fim da pesquisa na área, mas sim um período em que muitos projetos foram interrompidos ou diminuíram sua escala.

Foi uma fase de reflexão, aprendizado e, eventualmente, reestruturação do campo para superar os desafios que surgiram.

A história da IA, como em muitos campos científicos, é marcada por períodos de avanços intensos intercalados com períodos de avaliação e ajustes necessários para continuar avançando de maneira sustentável.

4. Edward Feigenbaum e o Renascimento com Sistemas Especialistas (1980)

A virada na história da Inteligência Artificial (IA) ocorreu na década de 80, impulsionada pelos revolucionários sistemas especialistas propostos por Edward Feigenbaum.

Esses sistemas, softwares desenvolvidos para realizar tarefas específicas ao simular o raciocínio humano em campos especializados, marcaram uma mudança significativa na aplicação prática da IA.

O impacto dos sistemas especialistas foi notável em diversas áreas, aproximando a IA do mercado corporativo e catalisando avanços significativos. Setores como medicina, finanças, manufatura e outros experimentaram uma transformação significativa devido à implementação bem-sucedida desses sistemas; mas calma… vamos explorar como cada uma dessas áreas foi impactada no tópico: Aplicações Práticas da Inteligência Artificial.

Assim, o renascimento da IA nos anos 80, centrado nos sistemas especialistas de Edward Feigenbaum, revitalizou a pesquisa no campo e trouxe avanços práticos que impactaram positivamente diversos setores, moldando o caminho para a evolução contínua da Inteligência Artificial.

5. Isaac Asimov e Suas Leis Robóticas

Outra grande figura que não podemos deixar de fora é Isaac Asimov. A influência de Isaac, renomado autor de ficção científica, foi fundamental.

Asimov contribuiu não apenas com histórias cativantes sobre robôs, mas também com as famosas “Três Leis da Robótica”, que estabeleceram princípios éticos para a interação entre humanos e máquinas inteligentes.

Ficaram curiosos para saber quais são as três leis da robótica de Asimov? As três Leis de Asimov são:

- Um robô não pode ferir um ser humano ou, por inação, permitir que um ser humano sofra algum mal.

- Um robô deve obedecer às ordens dadas por seres humanos, exceto nos casos em que tais ordens entrem em conflito com a Primeira Lei.

- Um robô deve proteger sua própria existência, desde que tal proteção não entre em conflito com as Leis anteriores.

Essas leis influenciaram não apenas a ficção científica, mas também a ética e a responsabilidade na pesquisa e implementação da IA na vida real.

Legado de Asimov e a Ética na IA

Isaac Asimov não apenas imaginou um futuro com máquinas inteligentes, mas também destacou a importância de incorporar princípios éticos na interação entre humanos e máquinas.

Seu legado continua a inspirar discussões sobre os dilemas éticos da IA, incluindo responsabilidade, transparência e privacidade dos dados.

Desde os primórdios até a atual revolução, a inteligência artificial continua a moldar o futuro, guiada por figuras como Isaac Asimov, cujo impacto transcende as páginas da ficção para influenciar o desenvolvimento real desta tecnologia.

Fundamentos da Inteligência Artificial: Conceitos-Chave

A compreensão dos conceitos fundamentais da Inteligência Artificial (IA) é essencial para explorar seu vasto potencial e suas aplicações práticas. Vamos desvendar alguns dos pilares essenciais da IA: aprendizado de máquina, redes neurais e processamento de linguagem natural.

Aprendizado de Máquina: A Essência da Inteligência Artificial

O aprendizado de máquina é o cerne da IA, representando a capacidade de sistemas se aprimorarem automaticamente por meio da experiência. Diferentemente da programação tradicional, onde as regras são explicitamente definidas, o aprendizado de máquina permite que as máquinas aprendam padrões a partir dos dados.

Principais Elementos:

- Algoritmos de Aprendizado: Os algoritmos são os motores do aprendizado de máquina, sendo responsáveis por extrair padrões dos dados e realizar previsões ou tomar decisões.

- Dados de Treinamento: A qualidade dos resultados depende da qualidade dos dados utilizados para treinar o modelo. Quanto mais diversificados e representativos, melhor o desempenho.

- Feedback Contínuo: Os modelos de aprendizado de máquina são aprimorados com feedback contínuo. À medida que recebem mais dados, ajustam suas estratégias para melhorar a precisão.

Redes Neurais: Inspiradas no Cérebro Humano

As redes neurais são estruturas computacionais inspiradas na complexidade do cérebro humano. Elas consistem em camadas de neurônios interconectados, cada camada processando informações de maneira progressiva.

Essa peça é fundamental para tarefas como reconhecimento de padrões, visão computacional e processamento de linguagem natural.

Principais Elementos:

- Neurônios Artificiais: Modelados a partir dos neurônios biológicos, os neurônios artificiais processam informações e transmitem sinais para as camadas subsequentes.

- Camadas Ocultas: Redes neurais muitas vezes possuem camadas ocultas entre a entrada e a saída, permitindo a extração de características complexas.

- Treinamento Interativo: O treinamento envolve ajustar os pesos das conexões entre os neurônios para minimizar erros e melhorar o desempenho.

Processamento de Linguagem Natural:

O processamento de linguagem natural (PLN) capacita os sistemas de IA a entender, interpretar e gerar linguagem humana de maneira eficaz.

Isso vai além do simples reconhecimento de palavras, envolvendo a compreensão de contexto, nuances e intenções.

Principais Elementos:

- Análise Sintática e Semântica: Compreende a estrutura e o significado das frases, permitindo uma interpretação mais profunda.

- Modelagem de Tópicos: Identifica os temas principais em um conjunto de texto, facilitando a categorização e a compreensão.

- Processamento de Voz: Integração de capacidades de compreensão e resposta a comandos de voz, possibilitando interações mais naturais.

Tipos de Inteligência Artificial

Além dos pontos essenciais que já mencionamos, vocês provavelmente estão curiosos sobre os tipos de Inteligência Artificial. Vamos abordar isso brevemente, pois esse tema merece mais detalhes em posts futuros.

De maneira geral, os tipos de IA se classificam conforme seu nível de capacidade e como são utilizados. Abaixo, destacamos três principais:

- Inteligência Artificial Limitada (ANI): projetada para executar tarefas específicas, ela armazena grandes volumes de dados e responde de forma eficiente dentro de um escopo limitado.

- Inteligência Artificial Geral (AGI): mais avançada, essa IA atinge um “nível humano”, sendo capaz de aprender, se adaptar e reagir a diversos estímulos de maneira autônoma.

- Superinteligência (ASI): ainda em desenvolvimento, essa IA é teorizada como superior à inteligência humana, com potencial para tomar decisões por conta própria e realizar tarefas que os humanos não conseguem executar.

Sugestão de leitura para você: 10 Ferramentas de IA para gestão empresarial!

Aplicações Práticas da Inteligência Artificial

A IA transcende teorias e conceitos abstratos, manifestando-se em uma variedade de aplicações práticas em diferentes setores. Separamos abaixo, algumas das áreas onde a IA está transformando operações, para que vocês possam conhecer:

Saúde:

- Diagnóstico Médico: Sistemas de IA auxiliam médicos na identificação de padrões em exames e imagens médicas para diagnósticos mais rápidos e precisos.

- Descoberta de Medicamentos: Algoritmos de aprendizado de máquina aceleram a pesquisa de novos medicamentos, identificando candidatos promissores.

Finanças:

- Análise de Risco: Algoritmos preditivos avaliam riscos financeiros, melhorando a precisão em decisões de empréstimos e investimentos em criptomoedas, por exemplo.

- Detecção de Fraudes: Sistemas de IA identificam padrões suspeitos em transações, contribuindo para a segurança financeira.

Manufatura:

- Manutenção Preditiva: Gêmeos digitais e aprendizado de máquina possibilitam a previsão de falhas em equipamentos, reduzindo tempo de inatividade.

- Otimização de Processos: Redes neurais contribuem para a otimização de linhas de produção, aumentando a eficiência.

Educação:

- A Inteligência Artificial colabora para a personalização do ensino. As plataformas coletam dados do aluno para adaptar o conteúdo ao ritmo e nível de proficiência dele, criando uma jornada de aprendizagem única.

Direito:

- A utilização da IA no Direito permite a otimização do trabalho de advogados sugerindo tarefas, abrindo prazos, ou até mesmo, fazendo análises preditivas.

Estes são apenas alguns exemplos, demonstrando como a IA está integrada em diversas áreas, impulsionando eficiência, inovação e resultados excepcionais.

Aprofundar-se nesses conceitos não apenas enriquece o entendimento, mas também prepara organizações para abraçar as vantagens competitivas proporcionadas pela Inteligência Artificial.

Desafios Éticos na Implementação da Inteligência Artificial

Como vimos anteriormente, a implementação crescente da Inteligência Artificial (IA) no cenário global traz consigo uma série de desafios éticos que exigem atenção cuidadosa.

Compreender e reconhecer essas complexidades é importante para garantir o desenvolvimento e a aplicação responsável da tecnologia.

Responsabilidade e Transparência

Um dos desafios fundamentais na implementação da IA é a questão da responsabilidade.

Quem é responsável quando um sistema de IA toma uma decisão errada ou prejudicial?

A opacidade dos algoritmos aumenta a complexidade dessa questão. Precisamos estabelecer diretrizes claras de responsabilidade e garantir a transparência dos sistemas de IA, permitindo que as pessoas entendam como as decisões são tomadas.

- Impacto: Definir responsabilidades claras contribui para uma implementação ética da IA, assegurando que as consequências de decisões automatizadas sejam compreendidas e atribuídas corretamente.

Privacidade dos Dados

A coleta e o uso de dados pessoais para treinar sistemas de IA levantam sérias preocupações sobre privacidade.

Como proteger informações sensíveis dos usuários, garantindo que não sejam mal utilizadas ou expostas?

Estratégias de segurança de dados e políticas claras de privacidade são imperativas para mitigar esses riscos.

- Impacto: Respeitar a privacidade dos indivíduos é necessário para construir uma base ética na implementação da IA, promovendo a confiança do público e evitando abusos de informações pessoais.

Requalificação e Transição

O avanço da automação exige a requalificação e a transição de profissionais cujas funções a tecnologia pode automatizar.

Investir em programas educacionais e de requalificação é importante para auxiliar os profissionais na aquisição de novas habilidades, adaptando-se às mudanças no mercado de trabalho.

- Impacto: A responsabilidade social na transição para uma sociedade impulsionada pela IA inclui garantir que os trabalhadores tenham oportunidades de se requalificar e contribuir de maneira significativa em novas áreas.

Compreender as complexidades da nossa área de atuação é necessário não apenas para garantir o desenvolvimento e a aplicação responsável da tecnologia, mas também informar as etapas de progresso rumo à automatização de processos, conforme detalhamos em nosso ebook “Do zero à automatização de Processos”.

A Importância da Ética na Pesquisa em IA

Os pesquisadores devem incorporar a ética desde as fases iniciais da pesquisa em IA. É essencial definir padrões éticos, considerando as implicações sociais e individuais, para evitar consequências não intencionadas.

Além disso, a conscientização, o diálogo aberto e o compromisso com padrões éticos elevados são fundamentais para moldar um futuro onde a IA contribua positivamente para a sociedade. Ao enfrentar esses desafios, estamos construindo um alicerce para uma inteligência artificial que respeita os valores humanos e beneficia a todos.

Tendências de IA para 2024

Estamos mergulhando cada vez mais nas aplicações de IA em diversos nichos de trabalho, por isso, um ponto bastante importante para finalizar nossa conversa é sobre as tendências de IA para 2024.

IA Quântica

Para quem está se introduzindo ao conceito, a computação quântica pode parecer algo saído de uma história de ficção científica. No entanto, ela está rapidamente saindo das páginas da ficção e se tornando parte central da pesquisa em Inteligência Artificial.

Ao explorar as complexidades dos qubits – unidades quânticas capazes de representar múltiplos estados simultaneamente – podemos compreender o impacto revolucionário deles no processamento de dados.

Não se trata apenas de uma possibilidade teórica; tanto startups promissoras quanto grandes empresas de tecnologia estão investindo recursos significativos no desenvolvimento de soluções quânticas.

À medida que 2024 avança, podemos esperar avanços notáveis nas capacidades de IA, especialmente em áreas que exigem a resolução de problemas complexos impulsionados pelos progressos na computação quântica.

IA de machine learning se tornará ainda mais sofisticada

Em 2024, podemos esperar um avanço crescente na sofisticação do machine learning (ML). Isso implica que os sistemas de inteligência artificial terão a capacidade de aprender e se adaptar de maneira ainda mais rápida e eficaz, abrindo novas perspectivas para aplicações em diversos setores.

Além disso, veremos a integração de algoritmos de deep learning com modelos mais complexos, permitindo que a IA resolva problemas cada vez mais desafiadores e específicos. A personalização em tempo real e a automação inteligente também ganharão destaque, transformando áreas como saúde, finanças e atendimento ao cliente.

Essa evolução aumentará a eficiência operacional e a tomada de decisões baseadas em dados, tornando as soluções de IA mais acessíveis e impactantes para empresas e indivíduos.

A IA se tornará mais acessível

O custo da IA está caindo, tornando-a mais acessível tanto para empresas quanto para curiosos e profissionais. O que significa que mais pessoas terão acesso aos benefícios da IA, impulsionando a inovação e a adoção em todo o mundo.

A IA será usada para tomar decisões

As decisões humanas agora contam com o auxílio de IAs para serem tomadas de forma mais assertiva e rápida. A IA analisa decisões complexas a partir de grandes volumes de dados, gerando insights mais precisos e fundamentados.

Isso possibilita a redução de erros humanos, além de agilizar processos críticos em áreas como medicina, finanças e logística. À medida que a tecnologia avança, a IA será capaz de considerar múltiplos fatores e variáveis simultaneamente, oferecendo soluções otimizadas em tempo real.

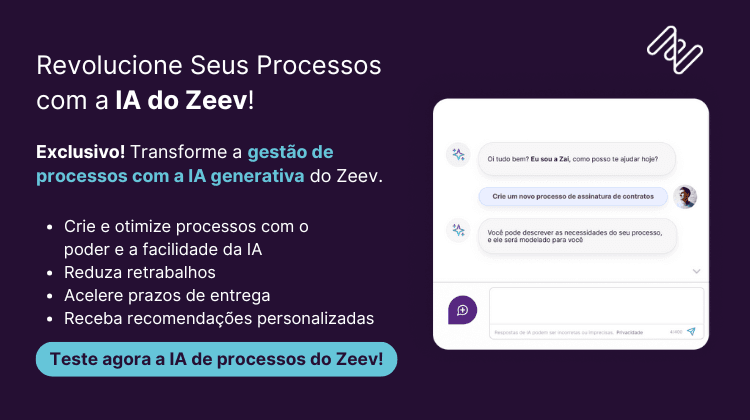

A IA será usada para automatizar tarefas

Por fim… A IA já está sendo usada para automatizar tarefas em diversos setores. Em 2024, veremos ainda mais essa automação, com a IA sendo usada para liberar os humanos para tarefas mais criativas e estratégicas. Nesse ponto, lembre-se de contar com a Zeev para auxiliar na automatização de processos da sua empresa.

Veja como funciona a automatização de processos com IA da Zeev:

Leia também: IA na gestão de processos: Dicas e Reviews

Concluindo sobre a História da IA

Desde a visão pioneira de Alan Turing até os dias de hoje, a jornada da inteligência artificial é, sem dúvida, uma narrativa marcada por inovações surpreendentes, desafios complexos e conquistas extraordinárias.

Ao olharmos para essa trajetória, a história nos mostra que a evolução da IA é contínua, sempre impulsionada por grandes avanços tecnológicos, superação de obstáculos e, principalmente, pela promessa de um futuro ainda mais empolgante.

Assim, à medida que gestores e gerentes de TI se aprofundam nos fundamentos da IA, é essencial reconhecer não apenas suas realizações ao longo do tempo, mas também as inúmeras oportunidades que já despontam no horizonte, prontas para transformar ainda mais o mundo ao nosso redor.

Não perca as últimas novidades e tendências sobre a Inteligência Artificial. Assine nossa newsletter para receber conteúdos exclusivos diretamente em sua caixa de entrada.

Esteja na vanguarda da inovação e da transformação, preparando-se para liderar a revolução da IA em seu setor.